本文带你拆解AI助手的核心技术原理,告别“只会用、不懂原理”的尴尬,面试实战与代码示例一网打尽。

一、开篇引入

在数字化转型浪潮中,阿勒泰AI助手已成为区域政务服务与智慧文旅的重要基础设施。2026年初,新疆阿勒泰地区推出的“泰小乐”政务服务机器人与“雪宝”文旅智能机器人相继亮相,成为AI技术深入民生场景的生动样本--1。许多开发者对AI助手的理解停留在“会说话、会回答问题”的浅层认知上——只会用、不懂原理、概念易混淆,面试时被问到“LLM和RAG什么区别”“AI助手和AI智能体有何不同”便卡壳。本文将从阿勒泰AI助手的具体案例出发,由浅入深拆解核心技术,涵盖:为什么需要AI助手(痛点分析)、核心概念(LLM与RAG)、关系辨析(AI助手 vs AI智能体)、代码示例、底层原理与高频面试题,帮助读者建立完整的知识链路。

二、痛点切入:为什么需要AI助手

在阿勒泰地区推出“泰小乐”之前,政务服务的典型场景是这样的:

传统人工客服模式(简化示例) class TraditionalCustomerService: def __init__(self, agents): self.agents = agents 有限的人工客服数量 self.work_hours = "09:00-18:00" def handle_query(self, user_input): 排队等待 → 人工回答 → 超出知识范围则转接其他部门 if not self.agents_available(): return "当前人工客服繁忙,请耐心等待..." if self.is_out_of_hours(): return "请在工作时间(09:00-18:00)咨询..." 人工回答速度有限,知识更新滞后 return self.transfer_to_agent(user_input)

传统方式的痛点十分突出:

时间受限:人工客服无法提供7×24小时服务,阿勒泰地区行政服务中心在非工作时段面临咨询积压问题。

响应效率低:常见问题重复回答,占用大量人力。

知识更新慢:政策法规变动时,人工培训周期长,容易给出过时信息。

多部门流转慢:群众常因一个问题辗转多个部门,体验差。

阿勒泰地区行政服务中心将12345政务服务便民热线与人工智能、大数据深度融合,推出“泰小乐”AI助手,24小时提供政策解答、流程指引等“自助式”答疑服务,有效分流人工咨询压力,常见问题即时解答率显著提升-。

三、核心概念讲解:大语言模型(LLM)

大语言模型(Large Language Model,LLM) 是基于Transformer架构,通过海量文本数据进行预训练,拥有数十亿乃至万亿参数的人工智能模型-。它本质上是让模型在海量文本中学习语言的统计规律和知识表征,从而具备理解自然语言并生成合理回应的能力。

🏠 生活化类比

把LLM想象成一个 “博览群书的学霸” :它在上岗前读遍了互联网上的海量文本、书籍、知识库,记住了大量知识和语言模式。当用户提问时,它能基于已学习的知识进行推理和回答——就像学霸不需要每次遇到问题都翻书,而是凭借记忆中的知识来给出答案-24。

💡 在阿勒泰AI助手中的作用

“泰小乐”正是基于DeepSeek大模型构建的线上智能客服,能为企业群众提供7×24小时的在线服务-6。依托DeepSeek大模型强大的数据分析和学习能力,“泰小乐”可快速识别办事需求,精准匹配政策法规与业务流程-2。

核心价值:让机器理解自然语言、具备推理能力、能够生成准确回应的“智能内核”。

四、关联概念讲解:RAG检索增强生成

RAG(Retrieval-Augmented Generation,检索增强生成) 是一种将信息检索与文本生成结合的技术框架。简单理解:RAG = 先检索资料,再让大模型基于资料生成答案-。

🏠 生活化类比

如果说LLM是“学霸的固有知识库”,那么RAG就是给学霸配了一个 “随时能查资料的助手” -24。当被问到最新的信息时(比如“2026年最新政策”),RAG会自动去知识库中检索相关内容,再把检索到的信息提供给LLM,让LLM基于最新资料来回答。这解决了LLM知识更新滞后的问题。

🔗 RAG与LLM的关系

| 维度 | LLM | RAG |

|---|---|---|

| 定位 | 认知引擎 | 增强机制 |

| 知识来源 | 预训练时固化 | 实时检索外部数据源 |

| 时效性 | 受限于训练数据截止时间 | 可实时获取最新信息 |

| 可解释性 | 黑盒 | 可追溯检索来源 |

一句话概括:LLM是“大脑”,RAG是“大脑的实时检索工具”——二者配合,让AI助手既能推理又能掌握最新信息。

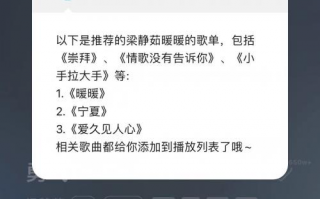

💡 在阿勒泰AI助手中的作用

“泰小乐”目前已整合梳理完成上万条办事指南和政策文件,不断优化知识图谱,持续对DeepSeek大模型进行训练和提升,这正是RAG架构在政务场景中的典型应用——政策库+LLM推理,实现“政策秒懂、业务快办”-5-2。

五、概念关系与区别:AI助手 vs AI智能体

很多开发者将“AI助手”与“AI智能体(AI Agent)”混为一谈,二者虽有联系,但本质不同。

📖 定义对比

| 维度 | AI助手(AI Assistant) | AI智能体(AI Agent) |

|---|---|---|

| 英文全称 | AI Assistant | AI Agent |

| 定位 | 被动响应、按指令执行 | 主动思考、自主规划与执行 |

| 能力边界 | 回答问题、提供信息 | 分解任务、调用工具、闭环执行 |

| 典型场景 | 客服机器人、智能问答 | 自动化办公、智能调度系统 |

| 示例 | “泰小乐”政策问答 | 自动订票、自动处理报销 |

🏠 一句话概括

大模型是“大脑”,AI助手是“会说话的大脑”,而AI智能体是“会行动、会协作、会学习的数字员工” -。

AI助手擅长执行简单明确的任务(如查询政策、路线导览),而AI智能体则具备自主规划和工具调用的能力——例如接到“安排一次团建”指令,能自动拆解为查天气、订场地、发通知等多个子任务,并判断优先级与依赖关系-。

💡 阿勒泰案例中的体现

“泰小乐”:AI助手的典型形态,被动响应用户查询,属于AI Assistant范畴。

“雪宝”:具备智能语音交互和场景定制能力,可根据不同环境进行适配,属于AI助手向AI智能体演进的过渡形态-1。

记忆口诀:助手答问题,智能体做事情。

六、代码/流程示例演示

6.1 RAG架构极简示例

极简RAG实现:政务政策问答 from typing import List, Dict class SimpleRAG: def __init__(self, knowledge_base: List[Dict]): 知识库:政策文档集合 self.kb = knowledge_base def retrieve(self, query: str, top_k: int = 3) -> List[str]: 简化版检索:关键词匹配(实际为向量检索) query_keywords = set(query.lower().split()) results = [] for doc in self.kb: 计算关键词匹配度 doc_keywords = set(doc["content"].lower().split()) match_score = len(query_keywords & doc_keywords) results.append((doc["content"], match_score)) results.sort(key=lambda x: x[1], reverse=True) return [content for content, score in results[:top_k]] def generate(self, query: str, context: List[str]) -> str: 模拟LLM生成:基于检索到的上下文拼接答案 if not context: return "抱歉,未找到相关政策信息。" 实际场景中会调用DeepSeek等LLM进行推理生成 return f"根据相关政策文件:\n{chr(10).join(context)}\n建议您:{query}具体办理请咨询当地政务服务中心。" def answer(self, query: str) -> str: RAG完整流程:检索 → 生成 relevant_docs = self.retrieve(query) return self.generate(query, relevant_docs) 模拟阿勒泰政务知识库 altay_kb = [ {"title": "医保异地报销流程", "content": "参保人需在就医前办理异地就医备案..."}, {"title": "住房公积金提取", "content": "连续缴纳公积金满6个月可申请提取..."}, ] rag = SimpleRAG(altay_kb) print(rag.answer("医保怎么异地报销?")) 输出:根据相关政策文件:参保人需在就医前办理异地就医备案...建议您...

6.2 AI助手 vs 传统客服效果对比

| 对比维度 | 传统人工客服 | 阿勒泰AI助手“泰小乐” |

|---|---|---|

| 服务时间 | 工作日09:00-18:00 | 7×24小时全天候在线-6 |

| 响应速度 | 排队等待+人工处理 | 秒级响应 |

| 多终端接入 | 电话/窗口为主 | 微信、小程序、网页全渠道覆盖-5 |

| 知识更新 | 人工培训周期长 | 知识图谱实时优化-5 |

| 并发能力 | 受限于人力规模 | 无限并发 |

从“窗口办”到“指尖问”,AI助手实现了从 “群众跑腿”到“数据跑路” 的根本性转变-2。

七、底层原理/技术支撑点

AI助手系统的核心技术架构通常包含 “感知层-认知层-应用层-安全层” 四个层级-11:

1. 感知层

负责捕获用户的多模态输入(语音、文本、图像)。例如“雪宝”依托智能语音交互系统与用户进行自然对话,这就是感知层的体现-1。

2. 认知层

是AI助手的“大脑”,负责意图识别、任务规划、动态优化。Transformer架构中的自注意力机制是这一层的核心技术——它让模型在处理每个词时,能够“关注”到句子中其他位置的相关信息,从而理解上下文语境。基于Seq2Seq、BERT、GPT等模型结构,实现高质量的语义理解与生成-。

3. 应用层

对接具体业务场景,将认知结果转化为实际服务。阿勒泰“泰小乐”对接“雪都泰好办”小程序、微信公众号等多渠道,正是应用层的落地体现-5。

4. 安全层

保障数据隐私与交互安全,在政务服务场景中尤为重要。

进阶预告:后续文章将深入拆解Transformer注意力机制、向量检索原理及AI智能体的工具调用实现。

八、高频面试题与参考答案

面试题1:LLM和RAG的区别是什么?什么场景用RAG?

标准答案(三个层次):

定位差异:LLM是预训练的大语言模型,知识固化在训练数据中;RAG是一种增强框架,通过检索外部知识库来提升生成质量。

场景选择:需要实时信息、私有知识库(如企业内部文档、政务政策库)时用RAG;通用问答、推理任务用LLM即可。

核心判断:“LLM解决‘会不会想’,RAG解决‘知不知道最新’。” 二者不是替代关系,而是互补关系。

面试题2:AI助手和AI智能体的核心区别是什么?

标准答案:

AI助手:被动响应,按指令回答问题,典型如客服机器人。

AI智能体:具备自主规划、工具调用、记忆管理能力,可主动执行复杂任务-。

一句话区分:助手答问题,智能体做事情。

面试题3:大语言模型的训练主要分为哪几个阶段?

标准答案:

预训练:在海量无标注文本上学习语言规律,构建基础能力。

监督微调:用人工标注的高质量问答数据进行有监督训练。

RLHF:通过人类反馈强化学习(Reinforcement Learning from Human Feedback)对齐人类偏好。

持续学习:基于新数据增量更新,保持模型时效性。

面试题4:RAG的核心流程是什么?有哪些优化方向?

标准答案(踩分点):

核心流程四步:索引构建 → 检索召回 → 结果融合 → 生成输出-。

优化方向:向量检索精度提升、多路召回策略、重排序模型引入、长上下文窗口利用。

九、结尾总结

本文围绕阿勒泰AI助手这一实际案例,梳理了AI助手技术的核心知识链路:

| 知识点 | 核心要点 |

|---|---|

| LLM | AI助手的“认知引擎”,预训练赋予推理能力 |

| RAG | 检索增强生成,解决知识时效性问题 |

| AI助手 vs AI智能体 | 前者被动响应,后者主动执行 |

重点强调:LLM与RAG是互补关系而非替代关系;AI助手到AI智能体的演进是技术深度递增的过程。在阿勒泰的实践中,“泰小乐”和“雪宝”的成功上线,验证了AI技术从概念走向民生的可行性——它不仅是技术问题,更是服务理念的跃迁。

下期预告:深入RAG架构,手写一个完整的向量检索+LLM生成系统,涵盖Embedding、向量数据库与Prompt工程,敬请期待!