兄弟们,家人们,最近是不是只要一刷手机,就能看到各种关于

广东数字人AI直播代理 的招募广告?那文案写得,简直让人热血沸腾:“躺赚佣金”、“24小时不间断直播,睡觉都在收钱”、“彻底取代真人主播”......说实话,我一开始看到这些也是嗤之以鼻的。心里琢磨,这不就是以前那种“机器刷单”的升级版吗?又来割韭菜了?但是,干我们这行(我自己在佛山做了七八年家具电商)的嗅觉告诉我,这事儿如果真像吹得那么玄乎,咱要是跟不上,可能真就被这个时代给抛下了。

尤其是咱们广东,做生意主打就是一个“快”字。为了搞清楚这玩意儿到底是“真经”还是“忽悠”,我这俩月特意没闲着,跑了广州、深圳好几家搞这个技术的公司,甚至还托关系找了个内部的朋友,深度扒了扒

广东数字人AI直播代理这个事儿。今天也不整那些虚头巴脑的术语,咱就坐在烧烤摊前,撸着串,跟大伙儿唠点实在嗑。一、为啥偏偏是广东?这地方“搞钱”的氛围太浓了!

你要问我为啥标题非得带“广东”俩字?这可不是为了博眼球。你得看数据,根据最新的工商信息,全中国做直播电商相关的企业,广东一省就占了6.5万多家,愣是干到了全国的14.6% -1。这是什么概念?走在广州白云区的皮具城、佛山的家具卖场、深圳华强北的柜台后面,十家店铺里可能就有好几家都在琢磨怎么开直播卖货。

人多地少,竞争就大。以前咱们请个主播,稍微像样点的,底薪加提成一个月没个万儿八千下不来,还得看她脸色,干得不爽说走就走,凌晨两三点的班死活没人上。我那朋友老陈,去年在南海搞了个直播基地,招了六个主播轮班,结果呢?人一闲下来就摸鱼,直播时状态忽高忽低,最后算账,赚的那点利润全填到工资和空调电费里了,自己白忙活一场。

所以,当“AI数字人”这个概念出来,广东这帮老板眼睛都绿了——这玩意儿不用睡觉、不用买社保、不会怼老板、更不会突然跳槽啊!

二、代理这玩意儿,到底能不能搞到钱?

这就是大伙儿最关心的点了。我这次去了解的 广东数字人AI直播代理 项目,说白了就是你去代理他们的系统,然后卖给那些想做直播但又请不起人、或者想降本增效的中小商家。

我以前也偏见,觉得AI播肯定很假,像个纸片人在那里念稿,谁会买?但我这次在花都区看到了一个事儿让我挺震惊的。人家花都区政府为了给老百姓解读政策,竟然用了AI数字人主播,叫“花小雯”和“花小常”,那形象就是根据真实员工做的,在镜头前挥手比心,讲话贼亲切 -2。连政府都敢用这玩意儿给老百姓办事儿了,说明技术在稳定性上肯定是过关了。

技术这块,阿里云也下场了。2月底刚宣布跟深圳一家叫平行宇宙的公司搞深度合作,专门给中小电商做高性价比的AI直播方案 -3。你想啊,有这些大厂在后面撑腰,算力和稳定性就不用咱们操心了。据说现在部署一个数字人直播间,成本能比请真人主播降低40% -3。注意啊,这不是小数目。对于那种卖佛山瓷砖、中山灯具的商家,一个直播间放一个AI,24小时给客户讲解产品,这转化率蹭蹭就上去了。

三、别踩坑!现在做代理要认准这三点

话又说回来,我跟那个搞技术的朋友喝酒,他也跟我倒了苦水,这也是我想给想做代理的兄弟们提的醒。

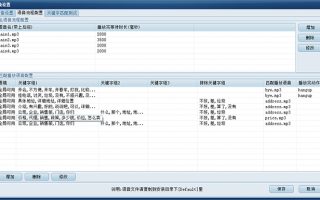

第一,合规问题现在是红线! 以前大家乱搞,弄个假的明星脸或者外国脸就开播,现在不行了。今年1月国家新出了规定,市场监管总局和网信办明确要求,凡是AI生成的主播,必须标识出来,得告诉消费者“这是数字人”,不能用来传播虚假信息或者冒充真人去诈骗 -1-6。所以你做代理找上家,一定要问清楚,他们的系统有没有打标功能,有没有嵌入那种看不见的“隐形水印”方便溯源 -5。如果找的上家连这个都支支吾吾,趁早别碰,别到时候被平台封号了,商家来找你赔钱。

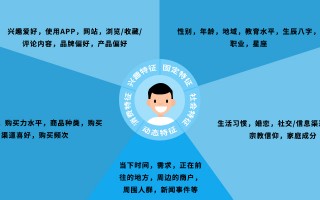

第二,AI不能“六亲不认”只念稿。 以前那种低端数字人,你问他“这衣服掉不掉色?”,他还在那里自顾自地讲“3、2、1,上链接”,粉丝一看就知道是机器,立马划走。现在好的技术,比如阿里云和平行宇宙合作的那种,强调的是高保真和互动 -3。你得找那种背后接了“大模型”的代理产品,数字人要能听懂粉丝问“适不适合30岁穿?”,然后调用数据库里的信息,用拟人化的口气回答你 -8。只有互动起来了,停留时长才够,平台才会给你推流。

四、写在最后的一点感触

我这俩月跑下来,最大的感触就是,以前咱们总觉得人工智能离自己很远,是那些大厂、科学家才玩的东西。但在广东这个地方,不管你是在番禺做服装的,还是在顺德做家电的,新技术来得就是这么迅猛。

就在前几天,那个“佛山优品”的直播基地也正式启用了,专门搞AI+电商,要帮本地的制造企业走出去 -4。这说明啥?说明官方也在推这个事情。以前那种靠堆人头、拼熬夜的直播时代,可能真的一去不复返了。未来的直播间,很可能就是几个真人主播带流量,后面几十个AI数字人分身24小时搞承接、搞转化。

咱也不是吹嘘这玩意儿多神,我也知道现在市面上很多搞培训、卖系统的就是在浑水摸鱼。但机会往往就藏在争议里。如果你现在手里有点本地商家资源,比如认识些开厂的老乡,他们现在生意不好做,正愁怎么把货卖出去,那你这时候去跟他聊广东数字人AI直播代理,帮他降本增效,这生意,我觉得比自己去开个直播店瞎折腾要靠谱得多。

好了,以上都是我这俩月的一线观察。我知道看完这篇文章,肯定有兄弟心里痒痒的,也肯定有兄弟觉得我是在帮人洗地。这都是正常的。咱评论区见真章,有不懂的随便问,我知道的都会回。

下面是针对大家可能最关心的几个问题,我模拟几个网友的口吻,咱们来一场隔空问答,把这事儿掰扯得更清楚些。

网友提问一:我是潮汕做牛肉丸的,厂子就在汕头。我也想做AI直播,但我听说数字人说话很生硬,客户进来一看就觉得是假的,扭头就走了。这玩意真的能卖出去货吗?还是说只能骗骗外行?

我的回答: 兄弟,你这个问题问到点子上了!我刚开始也是这么想的,AI那机械音能有啥说服力?但我亲眼见过之后,得跟你说句实话,时代变了。你说的那种“一眼假”的,那是前几年的“PPT级”数字人,确实该被淘汰。

现在的技术,拿阿里云刚升级的那个“惠宇AI数字人直播间系统”来说 -9,甚至已经能做到高保真还原人的微表情和语气。最关键的不是音色,而是脑子。现在的AI接了大模型,你说咱们潮汕话可能还费点劲,但普通话交流绝对没问题。它能根据粉丝的提问实时生成回答,比如粉丝问“你家牛肉丸含肉量多少?”,它不会像复读机一样说“请拍下二号链接”,而是能调用你事先存在数据库里的资料,回复:“家人们,咱们家丸子都是每天现宰的黄牛肉,含肉量九成五以上,咬一口爆汁的那种!”

至于“怎么让客户不划走”?我教你个在白云区那些皮具档口学来的绝招。你得给AI设计“人设”,比如咱们潮汕人做生意讲究“胶己人”,你让数字人穿个围裙,背景就设在你那个满是油烟的牛肉丸制作工坊里(实景拍摄),开场白设定成:“胶己人,没套路,今天看这锅新鲜出炉的丸子......”这种沉浸感和真实感,粉丝停留时间绝对比你想象的长。它不是要取代你的亲切感,而是要把你的亲切感无限复制下去。所以你担心的不是“假”,而是“会不会设计”。

网友提问二:我是外省的,想了解一下做这个代理的门槛高不高?我手头没几个钱,也不想囤系统,就怕被上家收了代理费就跑路。广东那边的公司靠不靠谱?

我的回答: 兄弟,防骗这根弦绷得紧是对的,给你点赞。现在市面上那种收个几万块代理费,然后丢给你一堆录播课就再也不管的“割韭菜”公司确实多。但你要找,就得找那种有硬实力背书的。

你想想,广东数字人AI直播代理之所以吸引人,是因为广东这边产业链成熟。你选上家,我教你三招:

第一,查它的“大腿”。你提到的那个阿里云和平行宇宙的合作 -7,还有像依托佛山市政府搞的那个“佛山优品”直播基地 -4,这种有大厂或政府背书的,跑路的概率就极低。他们卖的是长期服务,不是一锤子买卖。

第二,看“合规”底线。你跟他聊的时候,直接问:“国家现在要求数字人必须有标识,你们系统怎么解决?”如果他一脸懵,或者告诉你不用管,赶紧撤。因为2026年新规出来后,没有标识的AI直播随时可能被平台限流甚至封号 -6。真正靠谱的广东公司,现在已经在研究怎么在画面里嵌入隐形水印了 -5。

第三,问“降本”细节。不要只听他说能省多少钱,要问“省在哪”。比如,是不是用了阿里云的弹性算力,能在流量低谷时自动降低算力消耗,真正把成本降下来 -3。门槛其实不高,现在很多系统都是SaaS模式,按年付费,几千块就能起步,根本不需要囤货。你只要记住,你是去帮本地商家解决问题的,不是去给上家送人头费的。

网友提问三:我也打算搞这个代理,但在广州转了一圈,发现做这行的公司太多了,鱼龙混杂。你说,2026年再入局是不是有点晚了?这波红利是不是已经被最早那批人吃完了?

我的回答: 哈哈,你这心态跟我当年错过淘宝红利时一模一样。我反而觉得,现在恰恰是最好的时候! 为啥?因为野蛮生长的阶段刚刚结束,合规化的大幕才拉开。

你看啊,2025年那会儿,确实有人靠卖“AI无人直播”的噱头赚了快钱,但那会儿技术不稳定,而且很多是违规操作。但2026年1月新规出台,强制标识、纳入监管 -1-6,这意味着什么?意味着那些靠钻空子的“黑五类”玩家会被清洗出局。市场空出来了,而且变得更加规范,这时候入局,你面对的是一个更健康的市场。

更重要的是,应用的深度才刚刚开始。以前大家只会把AI丢在那里傻播,但现在随着阿里云这种大厂下场,技术门槛降低,广东数字人AI直播代理的生意模式正在从“卖软件”转向“卖服务”。比如,你可以帮那些东莞的电子厂、中山的灯具厂,针对不同平台(抖音、快手、TikTok)定制不同风格的AI数字人,甚至帮他们搭建几十个矩阵账号,批量生产内容 -3。

这波红利不是“信息差”的红利,而是“专业化服务”的红利。只要广东还是那个制造业的宇宙中心,只要这里的老板们还在愁怎么把货卖出去,你只要能帮他们省钱、省事、多卖货,你就永远有机会。别怕晚,就怕不做功课就一头扎进去。兄弟,我看好你,稳扎稳打,这局能赢!